Недавно Open AI представила Sora, нейросеть, создающую реалистичные видеоролики длительностью до минуты с разрешением 1080p на основе текстовых описаний.

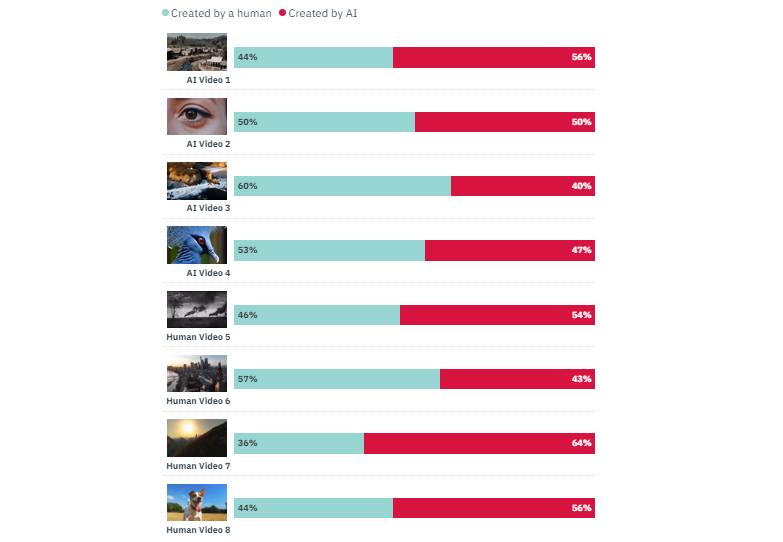

Исследование HarrisX показало, что большинство американцев не могут отличить эти видео от настоящих. В исследовании, проведенном с 1 по 4 марта в США с участием более 1000 человек, были представлены четыре видео, созданные нейросетью, и четыре реальных. Респонденты ошиблись в 5 из 8 случаев, выявив трудности в определении подлинности видео.

Это подчеркивает растущую реалистичность контента, создаваемого генеративными нейросетями, и вызывает беспокойство относительно его использования, особенно в индустрии развлечений. Существуют опасения относительно возможности использования Sora для создания фальшивых видео с политиками и знаменитостями. Поэтому многие страны призывают к законодательному регулированию этой области, включая обязательное маркирование контента, созданного нейросетями, для предотвращения дезинформации. Sora еще не доступна широкой публике, но уже вызывает значительные опасения в обществе.

Больше годноты на канале — Довольный Арбитражник

Обсудить и задать вопросы в чате — Арбитраж трафик

RU

RU EN

EN